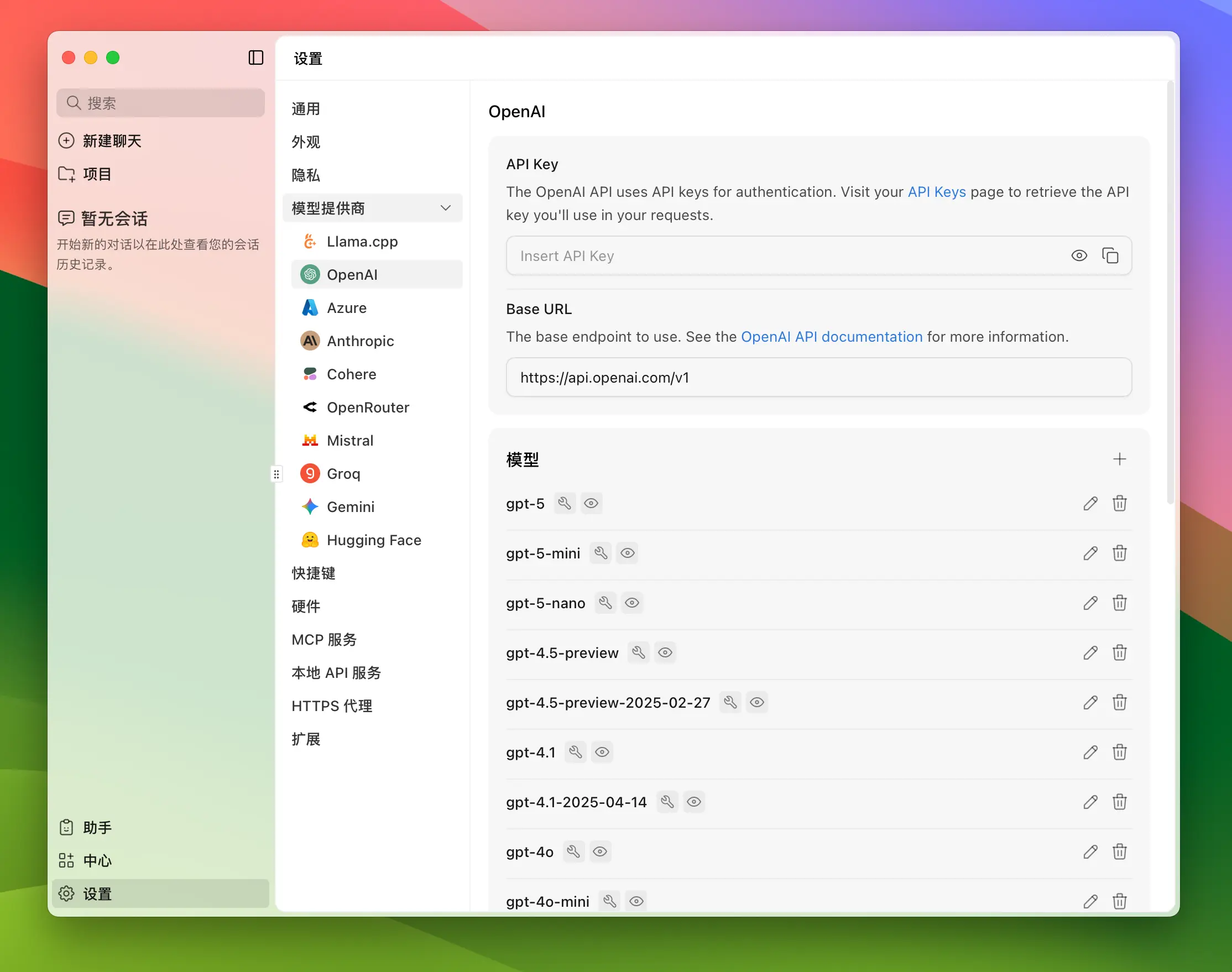

软件介绍

Jan 是一款开源 macOS AI 助手,支持在本地运行 Llama、Gemma 等大模型,保护您的隐私。同时集成 GPT、Claude 等云端 API,并可创建自定义助手。体验安全、强大、可定制的个人 AI 工作流。

在人工智能助手日益普及的今天,我们常常面临一个两难选择:是选择功能强大但需要将数据上传至云端的服务,还是为了隐私安全而牺牲性能和便利性?如果你是一位 macOS 用户,并且对这个选择题感到困扰,那么 Jan 或许就是你一直在寻找的答案。

Jan for mac 是一款开源的、跨平台的桌面应用,它将自己定位为一款“可离线运行”的 AI 助手。它巧妙地将本地运行的强大 AI 模型与主流的云端 API 服务融为一体,为用户提供了一个前所未有的灵活、安全且强大的 AI 体验。

Jan 的核心亮点与功能

1. 本地优先,隐私至上

Jan 最引人注目的特点就是其 “隐私第一” 的设计理念。应用内置了模型市场,允许你直接从 HuggingFace 等平台下载并运行各种开源大语言模型,如 Llama、Gemma、Qwen 等。这意味着你的所有对话、提示和生成内容都可以在本地设备上完成,无需将任何敏感数据发送到第三方服务器。对于处理机密文件、代码或个人笔记的用户来说,这是一个决定性的优势。

2. 云端集成,博采众长

虽然本地模型能力出众,但有时你可能需要调用云端更强大的模型(如 GPT-4、Claude 3)来应对复杂任务。Jan 对此提供了无缝支持。你可以轻松配置并连接到 OpenAI、Anthropic、Mistral、Groq 等多个主流云服务提供商。这种设计让你可以在本地模型的隐私性和云端模型的强大能力之间自由切换,实现最佳平衡。

3. 创建专属的 AI 助手

Jan 不仅仅是一个简单的聊天窗口。它允许你创建自定义助手。你可以为不同的任务(如编程、写作、翻译、数据分析)配置不同的助手,并为每个助手设定专属的系统提示词、选择最适合的模型(本地或云端)。这就像拥有一个由多个专家组成的团队,随时待命。

4. 强大的开发者与生态集成能力

Jan 不仅仅是一个独立应用,它更是一个 AI 枢纽:

- OpenAI 兼容的本地 API:Jan 可以在你的电脑上启动一个本地服务器(默认在

localhost:1337),并提供一个与 OpenAI API 格式兼容的接口。这意味着任何支持 OpenAI 的应用(如 Obsidian、VS Code 插件等)都可以无缝切换到使用你本地的 Jan 和其连接的模型,极大地扩展了其应用场景。 - 模型上下文协议集成:对 MCP 的支持是 Jan 迈向“智能体”能力的关键一步。MCP 允许模型更安全、更结构化地使用外部工具和数据源(如文件系统、数据库、网络搜索),为实现更复杂的自动化任务奠定了基础。

谁适合使用 Jan?

- 注重隐私的开发者与创作者:不希望自己的代码或创意内容被第三方服务用于训练。

- AI 爱好者与研究者:希望在自己的硬件上低成本地实验和对比不同开源模型的表现。

- 追求高效工作流的专业人士:需要通过自定义助手和 API 集成,将 AI 深度嵌入到自己的日常工具链中。

- 任何寻求更可控、更灵活 AI 工具的 macOS 用户。

总结

Jan 的出现,代表了一种新的趋势:AI 工具正变得日益个性化、去中心化和以用户为中心。它打破了“要么全部本地,要么全部上云”的二元对立,提供了一个优雅的混合解决方案。通过将隐私控制权交还给用户,同时又不牺牲与先进云端模型的连接能力,Jan 成功地定义了什么才是真正属于用户个人的、下一代 AI 助手。

应用截图

安装说明

- 点击上方"下载"按钮下载 .dmg 安装包

- 双击下载的 .dmg 文件打开安装镜像

- 将 Jan 拖拽到 Applications 文件夹

- 从 Launchpad 或 Applications 文件夹启动应用

系统要求

- >= macOS 11.0